企業がデータを使って迅速な意思決定を行うためには、散らばった情報を集約し、必要な形に整えて分析できる仕組みが必要になります。こうした仕組みを「データ分析基盤」と呼び、営業活動や経営判断を支える重要な基盤として注目を集めています。

本記事では、データ分析基盤の定義から構成要素、実際の構築ステップ、そしてツール選定のポイントまで、現場で役立つ具体的な情報をお伝えします。自社に最適な基盤を構築し、データ活用を推進したい方にとって参考になる内容です。

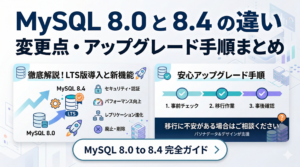

データ分析基盤とは?定義と導入効果を解説

「データ分析基盤」という言葉は聞くけれど、具体的に何を指すのか、なぜ必要なのか、よくわからないという方もいると思います。データ分析基盤を理解するには、まず「何を指すのか」「なぜ必要なのか」を明確にすることが大切です。企業活動では日々膨大なデータが生まれ、それを活かすには土台となる基盤が欠かせません。

データ分析基盤の定義と範囲とは?

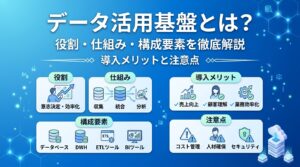

データ分析基盤とは、社内外に散在するデータを収集・蓄積・加工し、分析や可視化を行うための総合的な仕組みを指します。簡単に言えば、バラバラのデータを一箇所に集め、使いやすい形に整え、必要な人が必要なときに分析できる環境のことです。

この基盤には、データを取り込むための接続機能、保管するストレージ、分析用に整形する処理機能、そしてグラフや表で見える化するツールなどが含まれます。営業部門の顧客データ、製造部門の生産データ、マーケティングのウェブアクセス情報など、あらゆる情報源からデータを統合し、経営や現場の意思決定に役立てられます。

データ分析基盤の範囲は企業によって異なりますが、最低限「収集」「蓄積」「加工」「活用」という流れを支える仕組みを備えている必要があります。これにより、部門ごとに異なる形式で管理されていたデータを統一的に扱えるようになり、組織全体で情報を共有しやすくなります。

導入で期待される効果とは?

データ分析基盤を導入すると、意思決定のスピード向上が期待できます。従来は部門ごとにExcelや個別システムで管理されており、必要なデータを集めるだけで数日かかることもありました。基盤を整備することで、用途に応じて日次・時間単位・準リアルタイムなどで必要な情報へアクセスしやすくなり、迅速な判断につながります。

また、データの正確性や一貫性を高めやすくなる点も大きな効果です。同じ指標でも部門によって計算方法が異なると、経営陣が正しい判断を下しにくくなります。統一された基盤に加え、指標定義やメタデータ管理を整備することで、全社で共通の定義に基づいた分析を行いやすくなり、信頼性の高い情報に基づく戦略立案につながります。

さらに、分析業務の効率化も見込めます。データの収集や整形を自動化しやすくなることで、担当者は手作業の集計よりも分析そのものに集中しやすくなります。結果として、より深い洞察を得やすくなり、競争力の向上につながります。

導入に向く組織と代表的ユースケース

データ分析基盤の導入が特に有効なのは、複数の部門やシステムにデータが分散している組織です。営業、マーケティング、製造、物流など、各部門が独自のツールや表計算ソフトを使っている場合、情報の統合に手間がかかり、全社的な分析が難しくなります。こうした状況では、基盤を整えることで大きな効果が期待できます。

代表的なユースケースとしては、まずマーケティング分析が挙げられます。Webサイトのアクセスログ、広告の効果測定データ、顧客の購買履歴などを統合し、どの施策が効果的かを把握しやすくなります。次に、製造業における品質管理や生産効率の分析も重要な用途です。機械の稼働データやセンサー情報を一元管理することで、異常検知や予兆保全、生産計画最適化に向けた分析を進めやすくなります。

さらに、経営ダッシュボードの構築も代表的な活用例です。売上、利益、在庫、顧客満足度といった重要指標を一つの画面で可視化し、定期更新または用途に応じた頻度で確認できるようにすることで、経営陣が状況を把握しやすくなり、適切な指示を出しやすい環境を整えられます。

データ分析基盤を支える4つの基本要素

データ分析基盤は、いくつかの重要な構成要素によって成り立っています。ここでは、収集・蓄積・加工・活用という4つのステップに分けて、それぞれの役割と必要な機能を解説します。

データ収集|社内外の情報を一元的に取り込む仕組み

データ収集は、分析基盤の入り口にあたる重要なプロセスです。社内のさまざまなシステムや外部のAPIから情報を取り込み、一箇所に集約する仕組みを指します。営業管理システム、在庫管理システム、ウェブ解析ツールなど、複数のデータソースが存在する場合、それぞれに接続して自動的にデータを取得できる機能が必要です。

収集の方法には、定期的にまとめて取り込むバッチ処理と、リアルタイムで逐次取り込むストリーミング処理があります。どちらを採用するかは、データの特性や分析の目的に応じて選択することが重要です。(詳細は「ストリーミングとバッチ処理を使い分ける」の章で解説します。)

データ蓄積|安全かつ拡張性の高いストレージを設計

収集したデータを保管するストレージの設計も、基盤構築における重要な要素です。データは日々増加していくため、容量を柔軟に拡張できる仕組みが必要になります。クラウド環境であれば、必要に応じてストレージを追加できるため、急激なデータ増加にも対応しやすくなります。

蓄積の際には、データの形式や用途に応じて保存方法を選ぶことも大切です。生のデータをそのまま保管するデータレイクと、整形済みのデータを構造化して保管するデータウェアハウスを使い分けることで、分析の柔軟性と効率性を両立できます。

セキュリティ面も見逃せません。顧客の個人情報や企業の機密データを扱う場合、暗号化やアクセス制御を適切に設定し、不正アクセスやデータ漏洩を防ぐ必要があります。また、バックアップや災害対策も考慮し、データの可用性を確保することが求められます。

データ加工|分析やAI活用に適した形に整えるプロセス

蓄積されたデータは、そのままでは分析に使いにくい場合がほとんどです。欠損値の補完、形式の統一、不要な情報の削除など、さまざまな加工処理を施す必要があります。このプロセスをETL(抽出・変換・格納)またはELT(抽出・格納・変換)と呼び、分析基盤の中核を担う工程です。

データ加工では、まず異なるシステムから取得したデータの項目名や単位を統一します。たとえば、ある部門では「顧客ID」、別の部門では「会員番号」と呼んでいる項目を共通の名称に揃えることで、結合や集計が容易になります。また、日付のフォーマットや通貨単位なども統一し、一貫性のあるデータセットを作り上げます。

さらに、AI活用を見据えた加工も重要です。機械学習モデルで活用する場合は、用途やアルゴリズムに応じて、正規化やカテゴリ変数のエンコードなどの前処理が必要になることがあります。分析基盤の設計段階で、こうした加工処理を自動化できる仕組みを組み込んでおくと、後々の運用がスムーズになります。

データ活用|意思決定・DX推進につなげる分析と可視化

最終的には、整えられたデータを分析し、業務や経営の意思決定に活かす段階に入ります。可視化ツールやBI(ビジネスインテリジェンス)ツールを用いて、グラフやダッシュボードの形で情報を提示することで、誰もが直感的にデータを理解できるようになります。

分析の手法は、単純な集計やクロス集計から、統計分析、予測モデルの構築まで多岐にわたります。目的に応じて適切な手法を選択し、データから得られる洞察を業務改善や戦略立案に反映させることが、データ分析基盤の最終的なゴールです。

また、DX推進の観点では、分析結果を社内で共有し、組織全体のデータリテラシーを高めることも重要になります。権限に応じて必要なデータへアクセスでき、自ら分析しやすい環境を整えることで、現場主導のデータ活用が促進され、企業全体の競争力向上につながります。

データ分析基盤構築の主要コンポーネントとアーキテクチャを解説

データを「ただの数字」から「活用できる資産」へと変えるには、しっかりとした土台(分析基盤)が欠かせません。この土台は、データレイクやDWH、BIツールといった複数の要素を、目的や用途に合わせて適切に設計(アーキテクチャ)する必要があります。ここでは、基盤構築に不可欠な主要コンポーネントと、それらがどう組み合わさるのかを詳しく見ていきます。

データレイクとデータウェアハウスの役割を知る

データレイクは、生のデータをそのままの形で大量に保管できるストレージです。構造化されていないログファイルや画像、音声データなど、さまざまな形式のデータを一箇所に集約できるのが特徴です。柔軟性が高く、後から必要に応じて加工や分析を行えるため、まずは情報を集めておきたい場合に適しています。

一方、データウェアハウスは、整理・構造化されたデータを格納し、高速なクエリ処理を可能にするシステムです。データはあらかじめ整形され、テーブル形式で管理されるため、定型的な分析やレポート作成に向いています。ビジネスユーザーが直接SQLクエリを実行したり、BIツールと連携して可視化したりする際に活用されます。

両者は相互補完的な関係にあり、データレイクで生データを保管しつつ、必要なデータを加工してデータウェアハウスに移すという使い分けが一般的です。こうすることで、柔軟性と分析効率の両立が図れます。

データパイプラインとETL/ELTの設計のポイント

データパイプラインは、データの流れを自動化する仕組みを指します。収集、加工、蓄積、配信といった一連のプロセスを、スケジュールやトリガーに基づいて自動実行することで、手作業を減らし、データの鮮度を保てます。

ETLとELTは、データパイプラインにおける処理の順序を示す用語です。ETLでは変換処理をロード前に別の処理基盤で行うため、データウェアハウス側での変換負荷を抑えやすい構成です。。ELTでは、抽出後すぐに格納し、その後データウェアハウス内で変換を行います。最近のクラウド型データウェアハウスは処理能力が高いため、ELTの採用が増えています。

設計のポイントは、データ量や更新頻度、処理の複雑さに応じて適切な方式を選ぶことです。また、エラーハンドリングやリトライ機能、ログ記録などを組み込み、障害発生時にも迅速に対処できる仕組みを整えることが重要になります。

メタデータ管理とデータカタログ

メタデータとは、データに関する情報のことで、たとえば「この項目は何を表すのか」「いつ更新されたのか」「どこから取得したのか」といった説明が含まれます。メタデータを適切に管理することで、データの意味や由来を誰でも理解でき、誤った解釈や重複作業を防げます。

データカタログは、メタデータを一元的に管理し、検索や閲覧を容易にするツールです。社内のデータ資産を一覧化し、必要なデータがどこにあるかを素早く見つけられるようになります。データの利用履歴や品質情報も記録できるため、データガバナンスの強化にもつながります。

大規模な組織ほど、データカタログの導入効果は大きくなります。部門ごとに異なるデータが存在する場合でも、全社で共通のカタログを参照することで、情報の再利用や連携がスムーズになり、分析業務の効率が向上します。

可視化とBIの位置付け

可視化は、データを図やグラフに変換し、直感的に理解できる形で提示するプロセスです。数値の羅列だけでは見えにくい傾向や異常値も、ビジュアル化することで一目で把握できるようになります。

BIツールは、可視化に加えて、レポート作成やダッシュボード構築、アドホック分析などの機能を備えたソフトウェアです。データウェアハウスやデータベースに接続し、ドラッグ&ドロップの操作で簡単にグラフを作成できるため、専門知識がないビジネスユーザーでも、共有されたダッシュボードやレポートを通じてデータを把握しやすくなります。

分析基盤の設計では、BIツールをどの段階で配置するかを考える必要があります。データウェアハウスに直接接続する場合もあれば、集計済みのデータマートを用意してそこから可視化する場合もあります。利用者の人数やクエリの負荷を考慮し、最適な構成を選ぶことが重要です。

セキュリティとアクセス制御の基本設計のポイント

データ分析基盤には、企業の重要な情報が集約されるため、セキュリティ対策は欠かせません。まず、データの暗号化を徹底し、保存時と通信時の両方で情報を保護します。これにより、万が一データが漏洩した場合でも、内容を読み取られるリスクを低減できます。

アクセス制御も重要な要素です。誰がどのデータにアクセスできるかを明確に定義し、必要最小限の権限のみを付与することで、内部からの情報漏洩や誤操作を防ぎます。役割ベースのアクセス制御(RBAC)や属性ベースのアクセス制御(ABAC)といった仕組みを導入すると、柔軟かつ厳格な権限管理が可能になります。

また、監査ログの記録も欠かせません。誰がいつどのデータにアクセスしたかを記録しておくことで、不正アクセスや異常な操作を早期に発見でき、事後の調査にも役立ちます。定期的なログのレビューやアラート設定を行い、セキュリティインシデントを未然に防ぐ体制を整えることが求められます。

データ分析基盤構築の設計方針とツール選定

「データ分析基盤の構築が必要なのはわかったけれど、具体的にどう進めればいいのか」「自社に合った設計やツールの選び方がわからない」という方もいると思います。実際にデータ分析基盤を構築する際には、自社の目的や環境に合わせた設計方針を立て、適切なツールを選定することが成功の鍵となります。ここでは、要件定義からクラウドとオンプレミスの選択、製品選定、処理方式、運用自動化まで、具体的なポイントを解説します。

ユースケースに基づく要件定義の進め方

データ分析基盤の構築では、まず「何のために基盤を作るのか」を明確にすることが不可欠です。営業の効率化、在庫の最適化、顧客満足度の向上など、具体的な目的を設定し、それに必要なデータや分析内容を洗い出します。

次に、現場のユーザーや経営層にヒアリングを行い、どのような情報が欲しいのか、どの程度の頻度で更新が必要なのかを把握します。たとえば、リアルタイムに近い在庫状況の確認が必要なのか、日次での集計レポートで十分なのかによって、システム設計や選定するツールは大きく変わります。

要件定義では、データ量の見積もりも重要です。現在のデータ量だけでなく、今後の増加予測も考慮し、拡張性のある設計を心がけましょう。また、既存システムとの連携や、今後導入予定のツールとの接続性・互換性も確認しておくと、後々の手戻りを防ぎやすくなります。

クラウドとオンプレミス、どちらが良い?選定基準とは?

データ分析基盤の構築環境として、クラウドとオンプレミスのどちらを選ぶかは重要な判断ポイントです。クラウドは、初期設備投資を抑えやすく、必要に応じてリソースを柔軟に拡張しやすいのが魅力です。また、マネージドサービスを活用することで、インフラ保守の負担を軽減しやすくなります。

一方、オンプレミスは、自社内にサーバーやストレージを設置し、自社で管理する環境です。既存システムとの密接な連携を重視する場合や、自社の運用ポリシーに沿って細かく管理したい場合に選ばれることがあります。ただし、初期コストや運用負荷が大きくなりやすい点には注意が必要です。

選定基準としては、まずデータの機密性やコンプライアンス要件を確認します。業界や取り扱う情報によっては、データの保管場所や暗号化方法に一定の要件が求められる場合があります。次に、予算や人員、運用体制を踏まえ、自社でどこまで管理できるかを判断します。最近では、クラウドとオンプレミスの利点を組み合わせたハイブリッド構成も有力な選択肢です。

DWH/データレイク製品とBIツールの選び方

データウェアハウスやデータレイクの製品選定では、まず自社のデータ量、処理性能、接続したいシステム、運用体制などの要件を整理します。クラウド型の代表的なデータウェアハウス製品には、Google BigQuery、Amazon Redshift、Azure Synapse Analytics などがあり、それぞれに特徴があります。

たとえば、BigQuery はサーバーレスで利用しやすく、従量課金や容量予約などの課金モデルを選べる点が特長です。Redshift は AWS の各種サービスと連携しやすく、大規模な分析基盤の構成に適しています。Azure Synapse Analytics は、Azure の各種サービスとの統合性が高く、SQL やデータ統合、分析を組み合わせて活用しやすい環境です。

データレイクの保存基盤としては、Amazon S3 や Azure Data Lake Storage などが広く利用されています。これらは大量のデータを柔軟に保存しやすく、必要に応じて分析基盤と連携できる点が特長です。

BIツールの選定では、ユーザーの使いやすさと機能のバランスを重視します。Tableau、Power BI、Looker などが代表的な製品で、それぞれ操作性やデータソースとの連携性、共有のしやすさ、ライセンス体系などに違いがあります。実際に試用版を使い、現場のユーザーが操作しやすいかに加え、権限管理や既存環境との相性も確認することが重要です。

ストリーミングとバッチ処理を使い分ける

データの取り込みや処理には、ストリーミング処理とバッチ処理という2つの方式があります。ストリーミング処理は、継続的に発生するデータを順次取り込み、用途に応じて即時または短い間隔で処理する方式です。IoTセンサーのデータや、Webサイトのアクセスログなど、変化の早い情報を扱う場合に適しています。

バッチ処理は、一定の時間ごとにまとめてデータを取り込む方式です。日次や週次での集計が必要な売上データや在庫データなど、一括で処理しやすい情報に向いています。実行タイミングを制御しやすく、運用設計を行いやすい点がメリットです。

両者を使い分けることで、リアルタイム性とコスト、運用負荷のバランスを取りやすくなります。たとえば、在庫の変動監視はストリーミングで行い、月次の売上レポートはバッチ処理で作成するといった設計が考えられます。目的や優先度に応じて、適切な処理方式を選ぶことが重要です。

運用自動化とCI/CDの導入ポイントを知る

データ分析基盤を長期的に安定運用するには、手作業を減らし、自動化を進めることが重要です。データパイプラインのスケジュール実行、エラー検知とアラート通知、バックアップの自動取得など、日常的な運用タスクを自動化することで、担当者の負担を軽減できます。

CI/CD(継続的インテグレーション/継続的デリバリー)の導入も、運用効率を高める有効な手段です。データパイプラインやETL/ELT処理のコードだけでなく、SQL、ジョブ定義、ワークフロー設定、IaC(Infrastructure as Code)などの変更時にも、自動テストを実行し、問題がなければ段階的に反映できる仕組みを整えることで、変更作業のスピードと品質を両立しやすくなります。

また、運用自動化では監視ツールの活用も欠かせません。データ量の急増、処理時間の遅延、エラー発生率の上昇などの異常を早期に検知し、迅速に対応できる体制を整えることで、安定したデータ分析基盤の運用につながります。

データ分析基盤構築の具体的ステップとロードマップを解説

データ分析基盤は、「作って終わり」ではなく、「使われ続けてこそ」価値が生まれます。そのためには、現状分析から運用体制の確立まで、計画的なステップを踏むことが欠かせません。ここでは、実効性のあるデータ分析基盤を構築・運用していくための具体的な手順と、各段階で考えるべきポイントを整理します。

現状分析とデータアセスメントを行う

データ分析基盤の構築に着手する前に、まず自社のデータ環境を正確に把握することが重要です。どのシステムにどのようなデータが保存されているのか、データの形式や更新頻度、品質の状況などを調査します。

データアセスメントでは、データの所在や項目の一覧を作成し、どのデータが分析に必要かを整理します。また、データの正確性や完全性も確認し、欠損値や不整合が多いデータについては事前に対策を検討します。品質の低いデータをそのまま基盤に取り込むと、分析結果の信頼性に影響するため、この段階での確認が重要です。

現状分析では、組織の体制やスキルの状況も確認します。誰がデータを管理しているのか、分析や運用に必要なスキルを持つ人材がどの程度いるのかを把握し、必要に応じて教育や外部支援の計画を立てます。

PoCとパイロットで検証すべき項目を整理する

いきなり本格的な基盤を構築するのではなく、まず小規模な検証を行うことで、リスクを抑えやすくなります。PoC(概念実証)では、選定したツールや設計方針が実際に有効かどうかを確認します。特定の部門やデータセットに絞って試験的に基盤を構築し、データの取り込みや加工、可視化が期待通りに行えるかを検証します。

パイロット運用では、PoCで確認した内容をもとに、より実運用に近い形で試します。実際のユーザーに使ってもらい、操作性や機能の過不足、パフォーマンス上の課題などをフィードバックしてもらいます。この段階で課題を洗い出し、本番展開前に改善することが重要です。

検証では、データの精度やクエリの応答速度、エラーハンドリングの仕組みなども確認します。加えて、想定外の負荷がかかった場合の挙動や、障害発生時の復旧手順なども事前にテストしておくと、本番環境でのトラブルを減らしやすくなります。

PoCやパイロットで一定の有効性を確認した後は、その結果を踏まえて、運用性やセキュリティ、拡張性も含めて本番展開の可否を判断します。

本番環境の構築とデータ移行を進める

PoCやパイロット運用の結果を踏まえ、本番環境の構築に進みます。この段階では、スケーラビリティやセキュリティ、運用性を重視した設計を行います。ユーザー数やデータ量の増加を見越して、拡張しやすい構成にしておくことが重要です。

データ移行では、既存システムから新しい基盤へデータを移す作業が発生します。移行計画を詳細に立て、データの整合性を保ちながら段階的に進めます。移行方式によっては、業務影響の少ない時間帯に切り替えや移行作業を実施することもあります。

移行後は、データの検証を丁寧に行います。移行前後でデータの件数や内容に差異がないか、集計結果が一致するかなどを確認し、問題があれば速やかに修正します。この検証作業を十分に行うことで、後工程でのトラブルを防ぎやすくなります。

ローンチ後の運用体制と社内浸透

本番環境が稼働した後は、運用体制を整え、社内での活用を定着させる段階に入ります。まず、運用担当者を明確にし、日々の監視、障害対応、問い合わせ対応などの役割分担を決めます。運用手順や対応フローを整備し、役割に応じて一定水準で対応できる体制を構築することが重要です。

社内への浸透では、利用者向けの研修や説明会を開催し、基盤の使い方や活用事例を共有します。データ分析基盤は、実際に使われてこそ価値が生まれます。現場のユーザーが活用しやすいよう、サポート体制を整え、質問や要望に対応できる環境を用意しましょう。

また、定期的に利用状況をレビューし、どの部門がどのように活用しているかを把握します。活用が進んでいない部門には追加の支援を行い、全社的なデータ活用文化の醸成につなげます。

KPIを設定し効果測定を行う

データ分析基盤の導入効果を可視化するには、KPI(重要業績評価指標)の設定が欠かせません。たとえば、分析作業にかかる時間の短縮率、レポート作成の工数削減、意思決定に必要な時間の短縮など、業務上の効果を示す指標を定めます。

加えて、基盤そのものの運用品質を把握するKPIを設定することも有効です。たとえば、データパイプラインの成功率、データ更新遅延、クエリ応答時間、障害発生件数、復旧時間などを継続的に確認することで、基盤の安定性や改善余地を把握しやすくなります。

KPIは、導入前の状況と比較できるよう、事前に現状の数値を記録しておくことが重要です。基盤稼働後は定期的にKPIを測定し、目標値に対する進捗を確認します。目標に達していない場合は、原因を分析し、改善策を講じるサイクルを回すことで、継続的な価値向上につなげられます。

効果測定では、定量的な指標だけでなく、定性的なフィードバックも重要です。ユーザーの満足度や、分析結果がどのように業務に活かされたかといった情報を収集し、基盤の改善や今後の拡張計画に反映していくことが大切です。

データ分析基盤の先にある、AI活用まで見据えるなら

データ分析基盤は、構築して終わりではありません。

これからは、散在する社内データを集約・整備し、AIが活用できる状態まで設計することが重要です。

株式会社パソナデータ&デザインの「AI Ready Platform on OCI 導入支援サービス」は、OCI上にAI活用を前提としたデータ基盤を構築し、社内に分散した業務データを統合。Oracle Databaseをはじめ、SaaS・ファイル・社内DBなどのデータを、AIチャットやRAG、将来的なAIエージェント活用につなげやすい形で整備します。OCI上での暗号化、アクセス制御、監査ログなどのセキュリティ機能にも対応しており、安全性を重視したAI基盤の構築を支援します。

「分析しやすい基盤」だけでなく、「AIが使える基盤」まで整えたい方は、ぜひご相談ください。

株式会社パソナデータ&デザインの『AI Ready Platform on OCI 導入支援サービス』はこちら

まとめ

本記事では、データ分析基盤の定義から構成要素、構築ステップ、ツール選定のポイントまで、幅広く解説してきました。データ分析基盤は、企業内に分散するデータを統合し、迅速な意思決定やDX推進を支える重要な基盤です。収集・蓄積・加工・活用といった基本的な流れに加え、ガバナンスやメタデータ管理、セキュリティを含めて設計することが、継続的な活用につながります。

- データ分析基盤は、収集・蓄積・加工・活用を中心に、ガバナンスやメタデータ管理などの要素で成り立つ

- データレイクとデータウェアハウスを適切に使い分けることで、柔軟性と分析効率を両立しやすくなる

- 要件定義とユースケースの明確化が、基盤構築の方向性を決める重要な出発点になる

- クラウドとオンプレミスの選択では、機密性、コスト、運用体制、既存環境との接続性を踏まえて判断することが重要

- PoCやパイロットで検証を行い、本番展開前に課題を洗い出すことで、導入リスクを抑えやすくなる

- KPIを設定し、効果測定と改善を継続することで、基盤の価値を高めていける

自社に最適なデータ分析基盤を構築し、将来的なAI活用まで見据えてデータの価値を最大化したい場合は、要件整理や構想設計の段階から専門パートナーに相談するのも有効です。