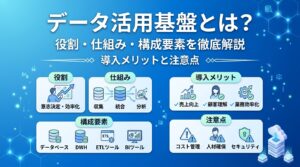

企業がDXを進めるうえで避けて通れないのが、データ基盤の整備です。多くの企業がデジタル化の必要性を感じながらも、データが部署ごとに分散し、どこから手をつければよいか分からず足踏みしているのが実情ではないでしょうか。データ基盤は単なるシステム導入ではなく、企業全体の意思決定を変革する仕組みづくりそのものといえます。

本記事では、DX推進に不可欠なデータ基盤の役割から、具体的な構築手順、さらには業務部門を巻き込んだ実践的なアプローチまでを体系的に解説していきます。

DX推進におけるデータ基盤の役割と重要性

「『DX推進にデータ基盤が重要』とは聞くけれど、なぜそれがないと前に進めないのか、その具体的な役割がよくわからない」という方もいると思います。DX推進の現場では、データ活用の重要性が叫ばれる一方で、実際にデータを集めて分析する基盤がないために前に進めない企業が少なくありません。データ基盤は単なるデータの保管場所ではなく、企業全体の活動を支える土台として機能するものです。

データ基盤がDXの土台となる理由

「DX推進にデータ基盤が重要」と言われても、なぜそれが必要なのか具体的な役割が分かりにくいと感じる方も多いでしょう。

DXの現場では、データ活用の重要性が認識されている一方で、データを収集・統合・分析するための環境が整っていないために、実際の活用が進まない企業も少なくありません。

データ基盤とは、企業内のさまざまなデータを収集・管理し、分析や業務活用を可能にするための仕組みを指します。

必ずしもすべてのデータを一箇所に集約する必要はありませんが、組織横断でデータを連携し、必要な人が適切なタイミングで利用できる環境を整えることが重要です。

従来、多くの企業では業務ごとに異なるシステムが導入され、それぞれの目的に応じた形式でデータが管理されてきました。例えば、販売データは営業システム、在庫情報は物流システム、顧客情報は顧客管理システムといった形で分散しているケースが一般的です。

このようにデータが分散した状態では、企業全体の視点でデータを分析することが難しくなります。

データ基盤を整備することで、こうした複数システムのデータを連携・統合し、横断的な分析を行いやすくなります。

たとえば、販売実績と顧客の購買履歴を組み合わせることで、どの顧客層にどの商品が売れているのかを把握し、マーケティング施策の精度を高めることが可能になります。

また、用途に応じてデータを適切な頻度で収集・分析できる環境が整えば、市場の変化をより迅速に把握し、経営判断に活かすことも可能になります。

サイロ化したシステムを統合・最適化する意義

サイロ化とは、部門ごとにシステムやデータが分断され、組織全体で共有・活用されていない状態を指します。

多くの企業では、長年にわたり業務ごとに最適化されたシステムが個別に導入されてきた結果、システム同士が連携しない「サイロ化」の状態になっていることがあります。

サイロ化が進むと、同じデータを複数のシステムで管理する必要が生じたり、データの定義や形式が統一されていないために分析が難しくなったりするなど、さまざまな問題が発生します。

データ基盤を整備すると、これらのシステムのデータを集約または連携させ、共通のルールのもとで管理できるようになります。

ただし、データを統合するだけで自動的に整合性が確保されるわけではありません。データ定義の整理、品質管理、アクセス権限の設計など、データガバナンスを含めた運用体制の整備が重要になります。

こうした仕組みが整うことで、企業内で信頼性の高いデータを共有しやすくなり、業務の効率化や分析の高度化を進めやすくなります。

また、システム間のデータ連携が進むことで、業務プロセスの見直しや自動化を検討しやすくなるという効果も期待できます。

データドリブン経営への第一歩になる

データドリブン経営とは、勘や経験だけに頼るのではなく、データに基づいて意思決定を行う経営スタイルを指します。

しかし、このような経営を実現するためには、意思決定に必要なデータが適切に収集され、分析できる状態になっていることが前提となります。

データ基盤が整備されると、経営層や各部門が業務データを可視化し、意思決定に活用しやすくなります。

たとえば、ダッシュボードを通じて売上や在庫などの指標を継続的に確認できるようになれば、状況の変化に応じた判断を迅速に行えるようになります。

さらに、データ分析の結果を営業戦略や商品開発に反映することで、顧客ニーズにより適切に対応できる可能性も高まります。

このように、データ基盤の整備は単なる業務効率化にとどまらず、企業の意思決定の質を高めるための重要な基盤となります。

DXデータ基盤構築の具体的な手順

データ基盤の構築は、単にシステムを導入するだけでは完結しません。現状を正しく把握し、目的を明確にしたうえで、段階的に進めていくことが成功への近道です。ここでは、一般的な構築プロセスを6つのステップに整理して解説します。

現状分析と課題の明確化

データ基盤構築の第一歩は、自社の現状を正確に把握することから始まります。どのシステムにどのようなデータが保存されているのか、データの形式や更新頻度はどうなっているのか、といった情報を棚卸しする作業が必要です。また、現場の担当者にヒアリングを行い、日々の業務でどのようなデータが必要とされているのか、どんな課題があるのかを洗い出す必要があります。

この段階で見落としがちなのが、データの品質やアクセス権限の問題です。古いデータが残ったまま放置されていたり、誰がどのデータにアクセスできるのか明確になっていなかったりするケースは珍しくありません。こうした現状の課題を可視化することで、データ基盤に求められる要件が明らかになります。

目的設定とユースケースの選定

現状分析が終わったら、次にデータ基盤で実現したいことを明確にします。単に「データを統合する」という漠然とした目的ではなく、具体的なユースケースを設定することが重要です。たとえば、「営業活動の進捗を必要な頻度で把握したい」「顧客の購買パターンを分析して商品企画に活かしたい」といった具体的な目標を掲げることが重要です。

ユースケースを選定する際は、経営層と現場の両方の視点を取り入れることが成功の鍵です。経営層が求める全社的な視点と、現場が日々感じている課題を結びつけることで、実効性の高いデータ基盤を構築できます。また、最初から大規模なプロジェクトを目指すのではなく、小さく始めて成功体験を積み重ねるアプローチが推奨されます。

要件定義とアーキテクチャを設計する

目的とユースケースが固まったら、技術的な要件を定義していきます。どのようなデータをどこから収集するのか、どのくらいの頻度で更新するのか、誰がどのデータにアクセスできるようにするのか、といった詳細を決めていく作業です。また、将来的な拡張性も考慮し、データ量の増加や新たなシステムとの連携に対応できる柔軟な設計が求められます。

アーキテクチャ設計では、オンプレミスかクラウドか、データレイク・データウェアハウス・データレイクハウスのどれが適切か、といった選択肢を検討します。近年では、初期コストを抑えられ、拡張性に優れたクラウドサービスを活用する企業が増えています。ただし、セキュリティ要件や既存システムとの相性も考慮しながら、自社に最適な構成を選ぶ必要があります。

データ統合とETL/ELTパイプラインを構築する

設計が完了したら、いよいよ実際にデータを統合するフェーズに入ります。ETLとは、Extract(抽出)、Transform(変換)、Load(格納)の頭文字をとった言葉で、異なるシステムからデータを取り出し、形式を揃えて、データ基盤に格納する一連のプロセスを指します。このプロセスを自動化することで、日々の運用負荷を大幅に軽減できるでしょう。

ETLプロセスの構築で注意すべきは、データの品質管理です。元データに不備があれば、いくら高度な分析ツールを使っても正確な結果は得られません。欠損値の補完、重複データの削除、フォーマットの統一といったデータクレンジング作業を組み込むことで、信頼性の高いデータ基盤を実現できます。

分析環境とダッシュボードを整備する

データが統合されただけでは、その価値を引き出すことはできません。次に必要なのは、データを可視化し、分析しやすい環境を整えることです。BIツールやダッシュボードを導入することで、経営層や現場の担当者が直感的にデータを理解し、意思決定に活用できるようになります。

ダッシュボードの設計では、ユーザーのニーズに合わせた表示内容を検討します。経営層には全社的な指標を大きく表示し、現場担当者には日々の業務に直結する詳細なデータを提供するといった使い分けが有効です。また、アクセス権限を適切に設定し、機密性の高いデータを保護することも忘れてはいけません。

運用体制を構築し継続的な改善を進める

データ基盤は一度構築すれば終わりではなく、継続的な運用と改善が必要です。運用体制を整える際には、誰がデータ品質を監視するのか、システムのトラブルが発生した際の対応手順はどうするのか、といった役割分担を明確にしておきましょう。また、ユーザーからのフィードバックを定期的に収集し、使い勝手の改善や新たな機能の追加を検討することも大切です。

運用フェーズでは、データの利活用状況をモニタリングすることも重要です。どのダッシュボードがよく使われているのか、どのデータが参照されていないのかを把握することで、投資対効果を評価するための判断材料とし、次の改善につなげられます。PDCAサイクルを回しながら、データ基盤を進化させていく姿勢が、長期的な成功を支えるのです。

業務部門との連携とユースケース駆動で進めるアプローチ

データ基盤の構築を技術部門だけで進めてしまうと、現場のニーズとかけ離れた仕組みになりがちです。実際に業務でデータを活用する部門と密に連携し、彼らの声を取り入れながら進めることが、実効性の高いデータ基盤を実現する鍵となります。

業務部門のニーズを引き出す方法

業務部門のニーズを正確に把握するには、現場での対話が欠かせません。単に「何か困っていることはありますか」と尋ねるだけでは、具体的な要望を引き出すのは難しいでしょう。むしろ、日々の業務フローを一緒に確認し、どの作業に時間がかかっているのか、どんな情報があればもっと効率的に働けるのかを掘り下げていく姿勢が求められます。

また、ワークショップ形式で複数の部門が集まり、データ活用のアイデアを出し合う場を設けるのも効果的です。他部門の取り組みを知ることで、自分たちの業務にも応用できるヒントが見つかることがあります。こうした対話を通じて、現場が本当に求めている機能や情報を明らかにしていきましょう。

小さな成功体験を積み重ねる

データ基盤の導入初期は、完璧を目指すよりも、小さな成功を積み重ねることが大切です。たとえば、特定の部署で試験的にダッシュボードを導入し、業務効率が改善されたという実績を作ることで、他の部署への展開がスムーズになります。成功事例が社内で共有されると、データ活用への関心が高まり、自発的に取り組む部署も出てくるでしょう。

小さく始めるメリットは、リスクを最小限に抑えられることにもあります。大規模なプロジェクトで失敗すると、予算や時間の無駄だけでなく、社内の信頼を失うことにもつながりかねません。一方、限定的な範囲で成果を出してから拡大していくアプローチなら、途中で軌道修正もしやすく、着実に前進できます。

データリテラシーの向上を支援する仕組みづくり

データ基盤を導入しても、現場の人々がデータをどう読み解き、どう活用すればよいか分からなければ、宝の持ち腐れになってしまいます。データリテラシー、つまりデータを理解し活用する能力を組織全体で高めていく取り組みが必要です。

研修プログラムやワークショップを定期的に開催し、データの見方や分析手法を学ぶ機会を提供しましょう。また、社内にデータ活用の相談窓口を設け、困ったときに気軽に質問できる環境を整えることも有効です。さらに、データ活用の成功事例を社内報やイントラネットで共有することで、他の社員も「自分にもできるかもしれない」と前向きに取り組むきっかけになります。

クラウドとAIを活用した最新技術の導入

「クラウドやAIがデータ基盤にどう役立つのか、具体的な導入方法やメリットがよくわからない」という方もいると思います。データ基盤の構築において、最新技術の活用は競争力を左右する要素となっています。クラウドサービスやAI技術をうまく取り入れることで、従来では難しかった高度な分析や迅速な意思決定が可能になります。

クラウドサービスを活用するメリット

クラウドサービスの大きな魅力は、初期投資を抑えて始めやすく、必要に応じてリソースを柔軟に拡張しやすい点にあります。オンプレミス環境では、サーバーやストレージの調達、構築、運用に一定の時間とコストがかかることが一般的です。一方でクラウドでは、比較的短期間で利用を開始しやすく、データ量や利用状況に応じてリソースを増減できるため、過剰投資を避けやすくなります。

また、クラウドではインフラの一部運用や物理設備の保護をクラウド事業者が担うため、社内IT部門の運用負荷を軽減しやすくなります。ただし、セキュリティ対策をすべて事業者に任せられるわけではありません。アクセス権限の設定、データ保護、ネットワーク制御、各種設定の適正化などは利用企業側の責任となるため、共同責任モデルを前提に設計・運用することが重要です。

さらに、クラウドサービスは新機能が継続的に追加されやすく、新しい分析機能やAI関連サービスを取り入れやすいという利点もあります。こうした特徴により、企業はインフラ管理そのものよりも、データ活用や業務改善により注力しやすくなります。

データレイクとデータウェアハウスを使い分ける判断基準

データを保管・活用する仕組みとしては、データレイク、データウェアハウス、データレイクハウスといった選択肢があります。データレイクは、構造化・半構造化・非構造化を含む多様なデータを、比較的生のまま保存しやすい仕組みです。一方、データウェアハウスは、分析しやすい形に整理・加工されたデータを格納し、定型的な集計やBI分析に適した仕組みです。レイクハウスは、データレイクとデータウェアハウスの利点を組み合わせたアーキテクチャとして広がっています。

どの方式が適しているかは、自社のユースケースによって異なります。多様なデータを柔軟に蓄積し、将来的な探索や機械学習に備えたい場合は、データレイクやレイクハウスが有力です。一方で、日々の業務報告やダッシュボードによる可視化を安定して行いたい場合は、データウェアハウスが適していることが多いでしょう。実際には、用途に応じてこれらを組み合わせる構成も一般的です。

AI・機械学習の活用による高度な分析基盤の構築

AIや機械学習を活用することで、従来の集計や可視化にとどまらない、より高度な分析が可能になります。たとえば、過去の販売データをもとに需要を予測したり、顧客行動から離脱リスクを検知したりすることで、将来を見据えた意思決定を支援できます。こうした用途は、企業がデータ基盤を整備する意義をさらに高めるものです。

ただし、AIを導入する際は、まず「何を改善したいのか」「どの業務判断に活かしたいのか」を明確にすることが重要です。AIはあくまで手段であり、目的が曖昧なまま導入しても成果にはつながりにくいからです。

また、AIや機械学習の精度・実用性を高めるうえでは、質の高いデータが重要です。用途によっては十分な量のデータも必要になりますが、必要なデータ量は一律ではなく、分析テーマやモデル、既存モデルの活用方法によって変わります。そのため、AI活用を見据える場合でも、「大量データありき」と考えるのではなく、まずは信頼できるデータを継続的に蓄積・管理できる基盤を整えることが重要です。

データ基盤とAIを適切に組み合わせることで、企業は分析の精度や意思決定のスピードを高めやすくなります。ただし、その効果を引き出すには、技術の導入だけでなく、目的設定、データ品質、運用体制まで含めて設計することが欠かせません。

DXデータ基盤構築における成功のポイント

データ基盤は、DXを実現するための「土台」であり、それ自体がゴールではありません。そのため、技術的な正しさはもちろん重要ですが、それ以上に「組織全体でどう使いこなしていくか」が成功を分けます。ここでは、技術選定の議論に留まらず、データ品質の担保や全社の協力体制といった、プロジェクトを成功に導くための多面的なポイントを解説します。

現場と共創しながら合意形成を進める

データ基盤の構築は、IT部門だけで進められるプロジェクトではありません。実際にデータを使う現場の人々が納得し、積極的に活用してくれなければ、投資の効果は限定的になってしまいます。そのため、プロジェクトの初期段階から現場を巻き込み、彼らの意見を反映しながら進めることが不可欠です。

合意形成のプロセスでは、現場が抱える課題やニーズを丁寧にヒアリングし、データ基盤がどのようにそれを解決できるのかを具体的に示すことが大切です。また、プロジェクトの進捗を定期的に共有し、フィードバックを受け付ける場を設けることで、現場の信頼を得ながら進められます。こうした共創の姿勢が、長期的な成功を支える基盤となるのです。

データ品質を担保するルールと運用プロセスの整備

どれほど高機能なデータ基盤を構築しても、格納されているデータの品質が低ければ、正確な分析や意思決定は不可能です。データ品質を担保するには、データの入力段階から厳格なルールを設け、それを守る仕組みを整える必要があります。たとえば、顧客情報を入力する際のフォーマットを統一する、欠損値が発生した際の対処方法を明確にするといった取り決めが考えられます。

また、定期的にデータの品質をチェックする運用プロセスを確立することも重要です。データのクレンジングや重複チェックを自動化し、異常値が検出された際にはアラートを発する仕組みを導入することで、常に信頼性の高いデータを維持できます。データ品質の管理は地味な作業ですが、データ基盤の価値を最大化するうえで欠かせない要素です。

スキル育成とトレーニングを組み込んだ体制の構築

データ基盤を効果的に活用するには、組織全体のデータスキルを底上げする必要があります。技術部門だけでなく、営業や企画、マーケティングといったあらゆる部門の社員が、データを読み解き、業務に活かせるようになることが理想です。そのためには、継続的なトレーニングプログラムを用意し、社員が自分のペースで学べる環境を整えましょう。

また、社内にデータ活用のエキスパートを育成し、各部門に配置する「データチャンピオン制度」を導入する企業も増えています。こうした人材が現場の相談役として機能することで、データ活用が組織全体に浸透しやすくなります。スキル育成は一朝一夕には実現しませんが、長期的な視点で取り組むことで、組織の競争力を高める原動力となるでしょう。

DXデータ基盤構築に役立つツールとサービス

DXデータ基盤を構築する際、すべてをゼロから自社開発するのは大きな負担となります。現在では、データ基盤の構築や運用を効率化する多くのツールやクラウドサービスが提供されています。これらを適切に活用することで、開発や運用の負担を軽減しながら、プロジェクトを迅速に進めることが可能になります。ここでは、自社の要件に合ったツールを選ぶための参考として、代表的なサービスをカテゴリー別に紹介します。

クラウドデータウェアハウス・クラウド分析基盤

クラウドデータウェアハウスやクラウド分析基盤は、大量データの保存・処理・分析をクラウド上で実行できるサービスです。代表的なものとして、Amazon Web Services(AWS)のAmazon Redshift、Google CloudのBigQuery、Microsoft AzureのAzure Synapse Analyticsなどがあります。これらのサービスは、大量データの高速処理やスケーラブルな分析環境を提供できるため、企業規模を問わず広く利用されています。

クラウド分析基盤を選ぶ際は、既存システムとの連携のしやすさ、コスト体系、運用のしやすさ、サポート体制などを総合的に評価することが重要です。また、セキュリティやコンプライアンス要件を満たしているかも確認しておきましょう。

ETL / ELT・データ統合ツール

ETL / ELTツールは、異なるデータソースからデータを抽出し、変換してデータ基盤へロードするデータパイプラインを構築・自動化するツールです。代表的なツールとして、Apache NiFi、Talend、Informatica PowerCenterなどがあります。

これらのツールを利用することで、手作業でのデータ処理を減らし、データパイプラインの自動化や運用の効率化を実現できます。また、データ変換や検証処理を組み込むことで、データ品質の改善を支援する役割も果たします。

ツール選定の際には、対応しているデータソースの種類、データ変換機能の柔軟性、運用のしやすさなどを確認することが重要です。また、ノーコードやローコードで操作できるツールを選ぶことで、専門的な開発スキルがない担当者でも扱いやすくなる場合があります。

BIツールとデータ可視化ツール

BI(Business Intelligence)ツールは、データを分析し、視覚的に分かりやすく表示することで意思決定を支援するツールです。代表的なものとして、Tableau、Microsoft Power BI、Lookerなどがあります。これらのツールでは、ドラッグ&ドロップなどの直感的な操作でダッシュボードを作成できるため、多くの企業で採用されています。

BIツールを活用することで、複雑なデータを視覚的に把握しやすくなり、迅速な意思決定を支援できます。ツールを選定する際は、ユーザーのITスキル、必要な分析機能、コストなどを考慮することが重要です。また、モバイル対応しているかどうかも、外出先でデータを確認する場合には重要なポイントになります。

一方、データ可視化ツールは、データの視覚表現に特化したライブラリやツールを指します。PythonのMatplotlibやSeaborn、JavaScriptのD3.jsなどが代表例です。これらはグラフやチャート、地図などの可視化をプログラムで柔軟に作成できる点が特徴です。

BIツールが「分析・集計・可視化を包括的に行うツール」であるのに対し、データ可視化ツールは「可視化の技術的実装」に重点を置いています。そのため、アプリケーションへの組み込みや高度なカスタマイズが必要な場合に利用されることが多いです。

データ品質管理ツール

データ品質管理ツールは、データの正確性や整合性を監視し、品質問題の検出や修正を支援するツールです。代表的なものとして、Talend Data Quality、Informatica Data Quality、IBM InfoSphere QualityStageなどがあります。

これらのツールを活用することで、データクレンジング、重複データの検出、データの標準化などを自動化し、データ品質の改善を支援できます。特に大量データを扱う企業では、データ品質の管理は分析結果の信頼性に大きく影響するため重要な役割を果たします。

ただし、データ品質の維持はツールだけで実現できるものではありません。データ入力ルールや運用プロセスなどのデータガバナンスと組み合わせて管理することで、より高品質なデータ環境を維持しやすくなります。

OCIでのデータ基盤構築ならパソナデータ&デザインへ

DXを支えるデータ基盤の構築には、クラウド設計、データ連携、セキュリティ設計など多くの専門知識が必要になります。

パソナデータ&デザインでは、Oracle Cloud Infrastructure(OCI)を活用したデータ基盤構築を支援する「AI Ready Platform on OCI 導入支援サービス」を提供しています。

OCI環境の設計からデータ連携、運用までを一貫してサポートし、DX推進に必要なデータ基盤の構築を支援します。

以下のような課題をお持ちの方は、ぜひサービスページをご覧ください。

- OCI上でデータ基盤を構築したい

- 社内にクラウド・データ基盤の知見が不足している

- AI活用を見据えたデータ基盤を整備したい

パソナデータ&デザインの『AI Ready Platform on OCI 導入支援サービス』はこちら

まとめ

DXを推進するうえで、データ基盤の整備は欠かせない取り組みです。本記事では、データ基盤の役割から具体的な構築手順、業務部門との連携、最新技術の活用方法までを解説しました。

データ基盤構築のポイントは次の通りです。

- データ基盤はDXを支える土台となり、サイロ化したデータの統合を実現する

- 構築は「現状分析 → 目的設定 → 設計 → データ統合 → 分析環境整備 → 運用」の段階で進める

- 業務部門と連携し、小さな成功体験を積み重ねることが重要

- クラウドやAIの活用により、柔軟で高度なデータ活用基盤を構築できる

- データ品質管理とデータリテラシーの向上が成功の鍵になる

データ基盤の構築は一度に完成するものではなく、段階的に整備しながら活用を広げていくことが重要です。自社の課題や目的を整理し、まずは小さなユースケースから取り組むことで、DX推進に向けたデータ活用を着実に進めることができます。